Мои текущие дела

1. Конечно работа, не без этого.

Мы создаем продукт по генерации контента для нескольких крупных компаний. Они приносят фото товаров и не хотят тратить время и деньги на студийные интерьерные фото: это дорого, медленно и плохо масштабируется. Например, у кровати может быть сотня материалов, и каждую нужно отфоткать в своем интерьере - физически снять все варианты в студии практически не реально.

Мы закрываем ту же задачу быстрее, дешевле и в любом объёме, со стабильным и предсказуемым процессом. С готовыми решениями вроде ChatGPT/NanoBanana мы конкурируем, но они редко дают нужную повторяемость: разово - ок, а для массовой генерации нужны люди, код, пайплайны и опыт под каждую категорию товаров. В итоге компания либо собирает аналогичную команду и инфраструктуру (дорого и долго), либо приходит к нам, платит и сразу запускает всё в продакшен.

2. Стартап

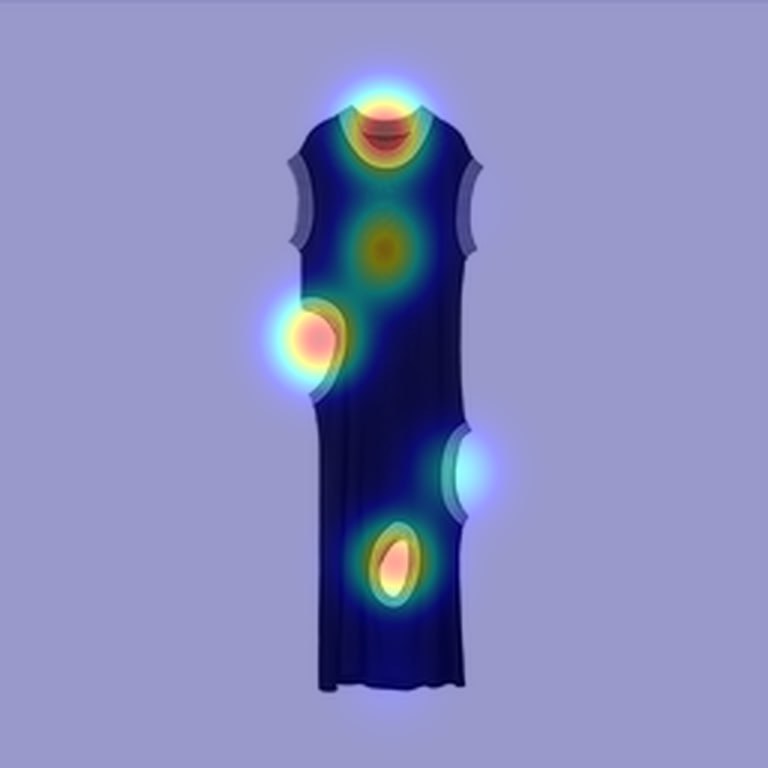

Я запускаю свой стартап: симуляция целевой аудитории для визуальной оценки качества рекламного креатива. В основе - психовизуальная модель внимания на стыке AI и научных исследований. В превью как раз показана часть работы движка - это предсказание куда уходит взгляд и внимание заданной целевой аудитории при просмотре товара. Наш движок решает задачу в общем виде, поэтому масштабируется как вертикально, так и горизонтально. Вертикально: генерация контента + отсев через метрику + интеграция в маркетинговую платформу = AI агент закрывающий полный цикл привлечения пользователей. Горизонтально в разных сферах: оценка Web UI, марчендайзинг, наружная реклама. Фактически везде, где важна визуальная оценка человеком. Сферу digital marketing выбрали, потому что здесь объединяется высокое количество контента и короткая обратная связь хорошо/плохо. Сейчас мы во втором цикле запуска: после первой итерации и интервью с клиентами переработали движок, подтвердили работоспособность и начинаем новый заход. Пожелайте удачи.

3. Наука

Сейчас я занимаюсь задачей определения момента, когда модель при обучении выходит в стационарный режим (фактически упирается в предел улучшений). По текущим экспериментам это можно диагностировать и критерий выглядит устойчивым: не зависит от шума, размера батча, оптимизатора, объема данных и других гиперпараметров. Остановка обучения по loss часто ненадёжна: иногда модель стоит останавливать раньше минимума loss, а иногда она продолжает улучшаться даже после плато или минимума. Дальше это ведет к более базовым вопросам DL - как устроено "обобщение", почему работает SGD, что считать сходимостью, сколько нужно данных и какие гиперпараметры действительно "гарантируют" результат. Сейчас многое решается эмпирикой и перебором (вплоть до AutoML), а строгой теории все еще не хватает - над этим я и работаю

Мои текущие дела

Ильдар Идрисов

Ильдар Идрисов